22 décembre 2008 : trois chercheurs des universités de Carnegie Mellon, Berkeley et Washington, Randal E. Bryant, Randy H. Katz et Edward D. Lazowska, publient un livre blanc intitulé "Big-Data Computing: Creating Revolutionary Breakthroughs in Commerce, Science and Society". Ils y évoquent notre monde piloté par les données et parlent de déluge de données. Ils y qualifient le Big Data de "possible plus grande innovation de la dernière décennie dans le secteur informatique". Le terme est né, même si la notion préexistait à cet acte fondateur.

Et c'est la déferlante des chiffres qui donnent le tournis : nous aurions au cours des deux années précédentes produit autant de documents que depuis l'Antiquité ; on se bat à coups de pétaoctets et on se demande où on va trouver les ressources et la puissance de calcul pour traiter et stocker ces montagnes de données. Aujourd'hui, les outils sont là et la maturité du Big Data est bien réelle. Le marché aussi, d'ailleurs : 210 milliards de dollars à horizon 2020, selon IDC et les chiffres de volumes vertigineux de 2008 ont évolué avec lui, dans les mêmes proportions. Mais les projets sont-ils à la hauteur des enjeux et des attentes ? Force est de constater qu'ils sont trop souvent encore en décalage avec le métier et par conséquent mal compris des équipes opérationnelles.

Pourtant, le salon Big Data, qui s'est tenu récemment à Paris, voulait illustrer la réalité de terrain de ces technologies au travers de nombreux témoignages. En préambule de la seconde journée, Mounir Mahjoubi, Secrétaire d'État auprès du ministre de l'Économie et des Finances et du ministre de l'Action et des Comptes publics, chargé du Numérique, a insisté sur la portabilité des données et sur leur nécessaire caractère centré sur l'utilisateur. Il est aussi venu marteler ses messages habituels (voir Syntec Numérique : l'idylle se confirme) sur la formation, professionnelle ou initiale, et de nombreux autres sujets, comme le potentiel démantèlement des GAFA. "Il n'est pas normal que ces services nous enferment dans leurs logiques. Il faut un monde plus régulé. Et ne nous leurrons pas, si la régulation est intelligente, elle est résolument pro-business". Autre sujet récurrent : l'inclusion de ces 13 millions de français, jeunes et moins jeunes, qui ne savent pas ou mal utiliser les outils numériques, ce qui dans un temple de la technologie comme cette manifestation avait quelque chose de décalé et de dérangeant : "les entreprises ont une responsabilité dans le processus d'inclusion, notamment celles qui se spécialisent dans le réseau, mais aussi les banques", a commenté le ministre. C'est aussi dans cette optique qu'il a déclaré que sa priorité dans l'immédiat était le Pass numérique. Objectif pour 2019 : que de l'ordre d'un un million et demi de personnes reçoivent ce Pass numérique qui leur permettra de se former au numérique pendant 10 à 20 heures auprès d'organismes agréés.

Dans la pratique

Pendant que des millions de Français ont bien du mal à suivre leur compte en banque ou à déclarer leurs impôts en ligne, les entreprises investissent dans des outils de BI, des data lakes, recrutent des data scientists, mettent en place des data labs et commencent à industrialiser leurs projets.

Ainsi en va-t-il de Swiss Life France, dont Cynthia Traore, responsable du data lab, explique lors d'une table ronde qu'elle est directement rattachée au CEO, ce qui permet de diffuser plus efficacement les informations aux métiers. Mais cette organisation n'est pas la seule possible : chez BNP Paribas Personal Finance, elle est au contraire décentralisée et les différentes entités rattachées à des DSI, selon Jérémie Guez, en charge du data lab. "Mais il faut un sponsor autour de la donnée", précise-t-il. "Chez nous, ce sont les quatre membres du COMEX". Autre organisation encore chez Malakoff Médéric, qui fonctionne en "squads", comme l'indique David Giblas, chief innovation, digital and data officer. Et deux indicateurs président aux destinées de ces squads : le ROI et l'avancement des tâches.

"Ce sont les membres du COMEX qui sélectionnent les use cases qui seront utilisés", admet Cynthia Traore. "Et certains sont de nature à bousculer un peu les habitudes des métiers". Aïssa Belaid, lead big data & analytics chez Engie, déplore "qu'on voit peu de use cases disruptifs sortir des entreprises". Plus qu'à un manque d'inventivité, il attribue cela aux difficultés de dialoguer avec les data scientists. "Et la route est parsemée d'échecs, dont on apprend, fort heureusement". "Nous n'avons pas connu d'échecs", s'insurge Cynthia Traore. "Parce que le mode itératif que nous avons adopté permet de se rendre compte rapidement si on fait fausse route".

Concrètement, Swiss Life a démarré avec un use case simple, autour de la satisfaction client. "Puis nous avons travaillé sur la lutte contre la fraude", poursuit Cynthia Traore. Chez Malakoff Médéric aussi, on a travaillé sur la fraude, mais aussi sur le commerce et le marketing et sur les envois d'e-mails. "On pourrait être tenté par des use cases multiples, mais il faut se focaliser sur certains sujets", estime David Giblas. "Car les projets Big Data sont de vrais projets de transformation, qu'il faut suivre de bout en bout. La focalisation permet d'en garder la maîtrise. Elle est d'autant plus nécessaire que le projet va durablement changer le mode de fonctionnement de l'entreprise".

La durée d'un projet va dépendre de la complexité du use case, mais pour fixer les idées on peut l'estimer à quelque six mois : trois mois sont typiquement nécessaires pour mettre au point l'algorithme et trois mois de plus pour la mise en place du projet. Ce n'est qu'ensuite qu'on pourra le déployer.

Quant à l'adhésion des métiers à ces projets et à la transformation qu'ils apportent, "nous faisons des algorithmes dits 'explicables'. Et il faut toujours évaluer l'impact d'un algorithme sur la société", déclare David Giblas. Aïssa Belaid estime que "les gens du métier ne sont pas sceptiques par rapport à l'algorithme. Chez nous, ils y croient. Mais il faut faire preuve de beaucoup de persévérance, ne pas vouloir aller trop vite et faire attention aux impacts de ce que l'on met en place".

De la navigation au Big Data

Fondateur de TeleAtlas et membre du conseil d'administration de TomTom, Alain de Taeye est venu expliquer en quoi et comment TomTom est passé d'une entreprise qui faisait de la navigation à une entreprise du Big Data. Qui ne connaît pas TomTom, ce système de navigation embarqué dans un véhicule sur six ? Et ce sont autant de voitures qui envoient des données à TomTom dès qu'elles sont en circulation.

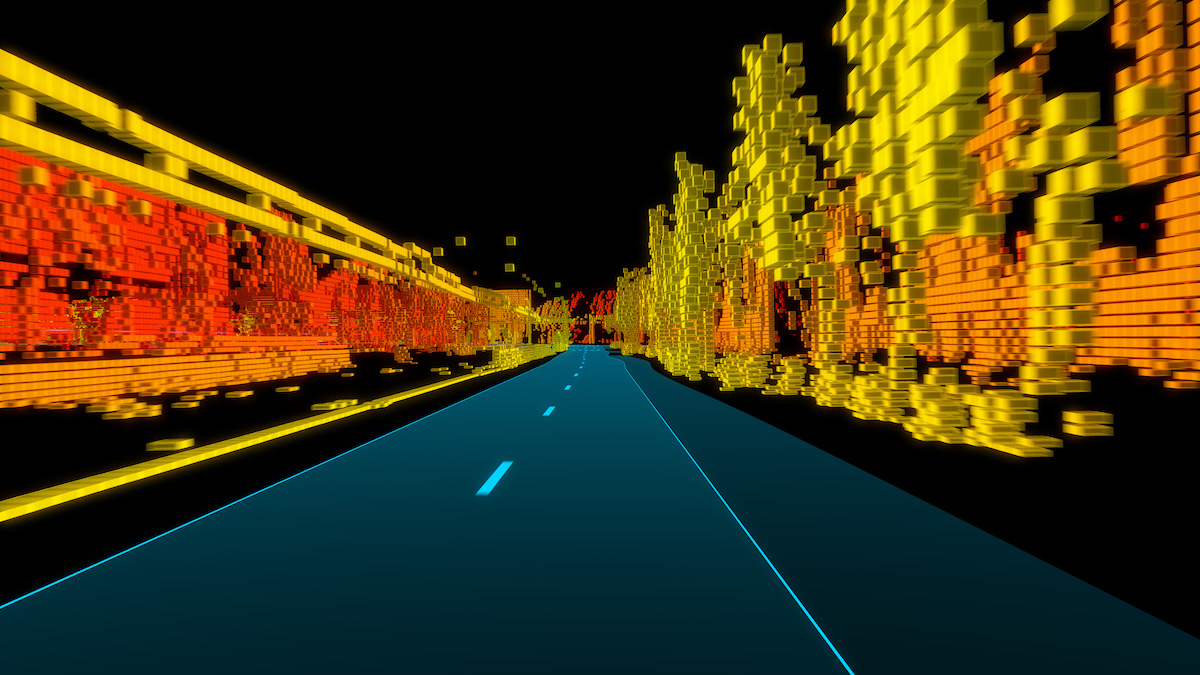

La technologie brevetée RoadDNA de TomTom fournit une vision optimisée en 3D,latérale et longitudinale, de la route.

La technologie brevetée RoadDNA de TomTom fournit une vision optimisée en 3D,latérale et longitudinale, de la route."Nos produits sont des cartes, des services et des logiciels", détaille Alain de Taeye. Alors dans ce contexte, pourquoi le Big Data ? "Il y plusieurs raisons à cela", poursuit le dirigeant. "La première est qu'il faut résoudre les problèmes, de mobilité en particulier. La seconde est que l'information doit désormais être à jour en temps réel. Il faut donc une vision de la réalité parfaite à tout moment. Enfin, la robotique : il nous faut faire ce que l'Homme sait faire, mais mieux, si possible. C'est le cas en particulier pour la voiture autonome ; dans une voiture, le logiciel devient plus important que le moteur !" On déplore 1,3 millions de victimes d'accidents de la route par an, essentiellement dues à des erreurs humaines. La voiture autonome signera-t-elle la fin de cette hécatombe ? Alain de Taeye y croit fermement : "la voiture autonome va réduire ce chiffre d'au moins 90 %".

Mais, alors qu'aujourd'hui déjà ce sont 21,47 milliards de points anonymes qui sont traités quotidiennement par TomTom, la voiture autonome exige des cartes encore plus détaillées, d'une précision de l'ordre de quelques centimètres et non de mètres, comme dans un système de navigation classique, et mises à jour en temps réel. Pour cela, outre les données GPS, on utilise aussi les radars dont sont équipés les véhicules, ainsi que les diverses caméras qui scrutent leur environnement. "Les données remontent ensuite vers nos systèmes, sont analysées puis renvoyées au véhicule. Et le tout en quelques secondes", explique Alain de Taeye. "Tout cela n'est que le début !"

Benoît Herr

l'information professionnelle des progiciels de gestion intégrés

l'information professionnelle des progiciels de gestion intégrés