L'image peut prêter à sourire. Mais sommes-nous aujourd'hui si éloignés d'une telle pratique ? Des produits logiciels comme LANDesk Application Virtualization par exemple, permettent déjà d'isoler des applications pour y accéder sans conflit tout en respectant l'intégrité des données et la stabilité du poste de travail, le tout sans aucune installation, sans modification du système client et sans installation d'agent ou de pilote sur le poste utilisé. L'esprit dans lequel se fait cette virtualisation du poste de travail'car c'est de cela qu'il s'agit?se limite pour l'instant aux applications individuelles de type Office ou navigateur Web, avec comme objectif de faciliter le déploiement de nouvelles applications, dans des organisations importantes en particulier.

La virtualisation, sous tous ses aspects, est considérée aujourd'hui comme l'une des priorités des services informatiques. Rien n'empêche d'imaginer que, dans un futur plus ou moins proche, l'éditeur encapsule ainsi toute une application ERP, ou en tout cas les éléments qui permettront d'une part de reproduire l'environnement de l'utilisateur et d'autre part d'accéder et de dialoguer, via une connexion sécurisée, avec les données et programmes qui seront restés centralisés, permettant à tout utilisateur de travailler à partir de n'importe quel poste, sous n'importe quel OS.

Vers la virtualisation des applicatifs

Au delà du rêve et de la description de l'une des facettes les plus pointues de la virtualisation, on constate que celle-ci va bien plus loin que la simple construction de machines virtuelles exécutées sur des serveurs ou sur le poste client lui-même. L'exemple ci-dessus permet de pointer du doigt le fait que, même si l'on considère souvent la virtualisation comme du domaine du matériel (cf. encadré), les applications et donc l'ERP seront tôt ou tard également dans le champ de cette technologie émergente et transformationnelle, comme on dit chez Forrester Research.

On distingue principalement trois types de virtualisations :

La virtualisation matérielle

La virtualisation du système d'exploitation

La virtualisation des applications.

La principale motivation poussant les entreprises à virtualiser est bien sûr la diminution des coûts, que ceux-ci concernent les équipements, c'est-à-dire les serveurs, le stockage, les réseaux ou encore la CPU ou les applications. Étant donné que les mises à jour applicatives et le déploiement de ces mises à jour sur l'ensemble des postes de l'entreprise sont généralement des processus longs, coûteux et fastidieux, la virtualisation des applications est aujourd'hui accueillie comme une bénédiction et est en plein essor.

Un concept très x86

Des serveurs blade

Des serveurs bladeIl y a une quarantaine d'années, IBM lançait un système d'exploitation baptisé VM (pour Virtual Machine, bien sûr), système d'exploitation qui a beaucoup évolué et fait aujourd'hui encore partie du paysage. VM est même capable d'exécuter jusqu'à 1000 machines virtuelles Linux sur une seule machine mainframe...

Entre temps, on a vu émerger des machines individuelles de type PC. Nettement plus économiques puisque destinées à un seul individu, elles sont également beaucoup moins sophistiquées que les systèmes de type mainframe, multi-utilisateurs, multi-personnalités et capables de virtualisation. Depuis la naissance des PC, la micro-informatique (ou informatique personnelle) n'a eu de cesse de consolider et d'interconnecter ses matériels et de réinventer la roue, côté logiciel, pour arriver à réaliser au final ce que le mainframe (mais aussi ce qu'il est convenu d'appeler les mini-ordinateurs) sait faire depuis toujours ou presque. Les PC présentent cependant un avantage : leur interface est devenue graphique... tout ça pour ça, me direz-vous ? Pas tout à fait quand même, car ils s'accompagnent aussi de leur cortège d'outils de productivité personnelle. Plus aucun cadre moyen ne fait encore taper ses courriers par une assistante.

Pour résumer, la virtualisation a été remise au goût du jour il y a une dizaine d'années, notamment avec l'émergence d'un acteur aujourd'hui devenu incontournable : VMWare. Particularité : ses produits concernent principalement les architectures x86 d'Intel (donc l'informatique personnelle et ses dérivés) et notamment les systèmes d'exploitation Microsoft, mais pas uniquement. Depuis, de nombreux acteurs ont vu le jour, qui dans l'administration de serveurs ou de centres de calcul comme Avocent, qui dans le reporting comme Systar. Même Intel, le principal constructeur de puces, est entré dans le jeu en introduisant la virtualisation et les innovations associées au sein même des semi-conducteurs.

Car si la réduction des coûts constitue le principal moteur de la virtualisation, la réduction de la consommation électrique est un bénéfice secondaire important. Elle s'obtient en réduisant le nombre de serveurs, ce qui diminue les besoins en climatisation et l'occupation au sol, mais aussi par la diminution de la consommation électrique des processeurs : c'est l'objectif d'Intel. La notion de "green computing" progresse, améliorant l'image de l'entreprise.

La micro-informatique n'a eu de cesse d'interconnecter ses matériels et de réinventer la roue côté logiciel pour arriver à réaliser au final ce que le mainframe sait faire depuis toujours ou presque.

Mais, et SOA ?

Les américains ne s'y sont pas trompés puisqu'ils associent SOA et virtualisation à l'occasion de l'événement de novembre dernier à San Francisco (http://www.soaworld2007.com/). Car enfin, que représente SOA si ce n'est la virtualisation des applications ?

Comme son nom l'indique, SOA s'appuie sur des services, qu'ils soient Web ou non. Or un service applicatif se conçoit comme une entité à laquelle on fait appel pour rendre un service. Il peut s'agir de fournir le prochain numéro de commande ou de facture dans la séquence, d'envoyer un e-mail à un responsable concerné par l'action en cours ou d'effectuer un calcul, comme le traditionnel et célèbre calcul de clé RIB, par exemple. Mais l'application n'a pas besoin de savoir à quel endroit est hébergé ce service, d'où il vient et ce qu'il devient par la suite. En d'autres termes, ce service devient virtuel, c'est-à-dire qu'on introduit une couche d'abstraction logicielle entre l'application et les services qu'elle utilise

De la virtualisation "traditionnelle" à la virtualisation de l'ERP

La plus courante de ces couches, celle permettant à plusieurs machines virtuelles de s'exécuter sur une même machine physique avec des OS souvent différents, est logicielle et se place entre le matériel et le logiciel : il s'agit des "hyperviseurs"... Cet air ne serait-il pas connu ? On en arrive ainsi à virtualiser clients et serveurs et même les données deviennent virtuelles, c'est-à-dire que l'utilisateur ne sait plus exactement où elles se trouvent : il ne les voit qu'à travers son interface.

Ce que venons-nous de décrire correspond aussi à un autre modèle, celui de l'ASP (Application Service Provider) et du SaaS (Software as a Service). D'ailleurs, dans la signification même des termes ASP et SaaS on retrouve celui de "service". L'ERP dans son ensemble devient ainsi virtuel. En mode SaaS ou ASP, c'est l'ERP (ou toute autre application) dans son ensemble qui se conçoit comme un service : on n'utilise plus un applicatif maison ou un progiciel hébergé en interne pour alimenter des fichiers commandes ou factures, mais l'approche devient fonctionnelle : "Je veux passer une commande", "Je dois faire une facture" ou encore "Je vais faire ma note de frais". Peu importe ce qu'il en est de l'application, l'essentiel étant que le service soit rendu au moment où il faut.

Au bout du compte, "demain" se "téléscope" ici avec aujourd'hui, puisqu'il suffit d'encapsuler son environnement ERP et de le placer sur une clé USB pour pouvoir accéder de manière complètement virtuelle à son ERP favori depuis n'importe quel poste connecté à l'Internet. Bien sûr, la PME française moyenne n'en est pas encore à ce niveau de virtualisation (selon Forrester, seuls 38% des entreprises au monde ont une expérience de la virtualisation de serveurs x86, par exemple), mais pas si éloignée, à bien y réfléchir.

Benoît Herr

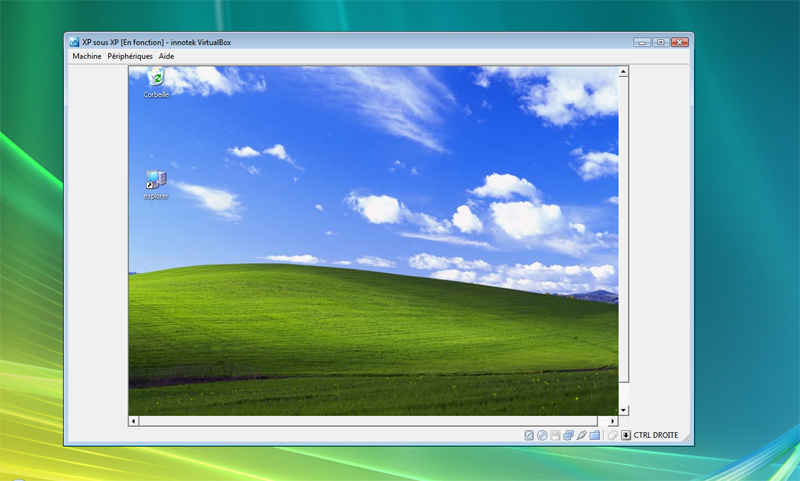

Une machine virtuelle Windows XP

s'exécutant dans Windows Vista avec Innotek VirtualBox Une machine virtuelle Windows XP

s'exécutant dans Windows Vista avec Innotek VirtualBox |

Selon le Gartner, la virtualisation sera la tendance lourde du marché de l'infrastructure d'ici à 2012

Un récent rapport spécial du célèbre cabinet de conseil se penche sur la manière dont la virtualisation va remodeler les règles de gestion et de déploiement de l'informatique ainsi que les comportements d'achat.

Le cheval de bataille de ce mouvement sera la virtualisation de serveurs (ce que confirme Forrester), qui devrait aboutir à la libération de capacités de traitement sous-utilisées. Selon le Gartner, celle-ci aurait déjà un impact sur le marché des serveurs x86, qui ont connu une baisse de 4 % en 2006. Avec la baisse des coûts des hyperviseurs, le Gartner estime que plus de 4 millions de machines virtuelles auront été installées sur des serveurs x86 à l'horizon 2009.

La virtualisation des postes de travail croit également rapidement. Leur nombre devrait passer de moins de 5 millions en 2007 à 660 millions en 2011. Ici il s'agit bien sûr de virtualisation du système d'exploitation, mais aussi des applications. Cela dit, le Gartner estime que malgré un intérêt croissant pour la virtualisation d'applications, c'est celle des systèmes d'exploitation qui aura le plus d'impact sur le long terme car elle apporte souplesse, sécurité et facilité de gestion à l'informatique personnelle.

l'information professionnelle des progiciels de gestion intégrés

l'information professionnelle des progiciels de gestion intégrés