Lors du débat organisé par le club de la presse informatique B2B sur le thème "les possibilités illimitées de l'analyse prédictive : l'avenir à portée de clic ?", six intervenants ont donné leur point de vue. Jean Charles Ravon, data scientist chez Teradata en donne l'objectif : "analyser l'existant, en affiner la compréhension et en tirer des tendances pour le futur."" "Ce n'est pas un marché en tant que tel, considère Alain Pétrissans, vice-président associé du cabinet détudes IDC. Pour l'enquête que nous avons menée à ce sujet, nous avons choisi l'angle du Big Data car c'est celui qui l'exprime le mieux."

Big Data, prédiction et prescription

Cliquez sur l'image pour l'agrandir

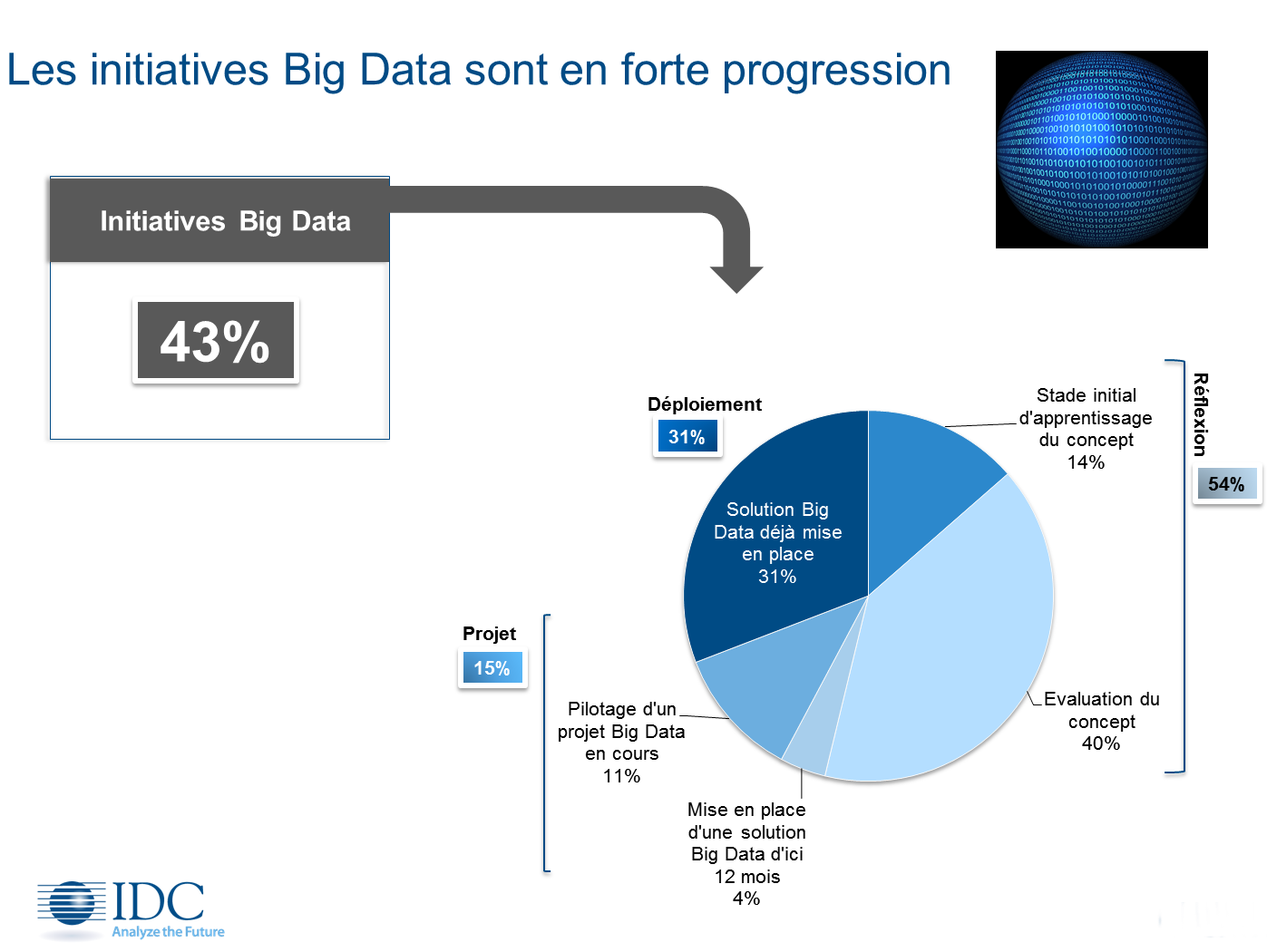

Cliquez sur l'image pour l'agrandirLes entreprises interrogées dans le cadre de cette enquête gèrent toutes un gros volume de données : 43 % d'entre elles ont lancé des projets Big Data et 31 % ont déjà déployé une solution dans ce domaine. Les domaines d'application concernent surtout l'innovation dans les produits et services et la stratégie des prix, mais aussi l'analyse concurrentielle, le contrôle des opérations et la fidélisation des clients. Moins d'un tiers des données de l'entreprise sont réellement analysées, les données structurées l'étant beaucoup plus que les données non structurées. Au-delà des enjeux technologiques, il faut définir les besoins des métiers. Mais le manque de compétences analytiques dans l'entreprise pose problème. Enfin la sécurisation des budgets est essentielle pour le lancement des projets.

"Le Big Data permet d'enrichir l'analyse avec des données que l'on n'avait pas jusqu'ici, explique Laurent Ridoux, directeur technique Big Data chez HP. C'est particulièrement vrai de celles qui proviennent des réseaux sociaux." La variété et la quantité des données contribuent à la pertinence des modèles.

Marc Chemin, directeur du planning stratégique chez Capgemini, distingue l'analyse prédictive de l'analyse prescriptive. Le secteur de la distribution fait beaucoup de prescriptions en direction des clients à partir de l'analyse de ses habitudes. "Cette tendance va se développer dans les assurances et dans la santé. On pourra bientôt adapter les traitements médicaux à l'individu", assure-t-il. Quant à la prédiction, elle s'applique à tous les domaines. On parle par exemple de maintenance prédictive. Dans un avion en vol, de nombreux capteurs enregistrent des données sur les moteurs. Récupérées après l'atterrissage, celles-ci permettent de déterminer quelles pièces sont usées et doivent être changées. Dans le domaine de la santé, les données sur l'état de santé permettent de mettre en évidence un risque d'infarctus et de conseiller des règles d'hygiène de vie.

Qualité des données et temporalité influencent la fiabilité des prévisions

"Le taux de fiabilité d'une analyse est d'autant plus élevé qu'il concerne des domaines que l'on connaît bien. C'est le cas, par exemple, des machines et de tous les éléments mécaniques", relève Jean Charles Ravon. A contrario, le comportement humain est le facteur le plus difficilement modélisable. "On n'y arrivera probablement jamais, affirme Marc Chemin. Ainsi, lors d'une épidémie de grippe aux États-Unis, une analyse effectuée à partir des connexions et des requêtes sur Internet avait abouti à une prévision d'infection de 11 % de la population. Elle s'est révélée très surévaluée car le nombre de personnes connectées n'était pas proportionnel à la taille de la population."

Pour Frédéric Brajon, directeur de lactivité Big Data et Data Science chez CGI Business Consulting, "la temporalité joue un rôle important. Plus la date est éloignée, moins la prévision est fiable." Ainsi, si un moteur de recommandation d'achat est fiable, certaines prévisions financières comportent des risques importants. Cela a été le cas avec la crise des subprimes où certains événements potentiels considérés comme lointains, en l'occurrence la baisse de l'immobilier, se sont brutalement réalisés.

Mais le but n'est pas d'obtenir 100 % de réussite dans les prévisions liées au comportement humain, ainsi que l'explique Alain Pétrissans : "il s'agit par exemple de diminuer le taux d'attrition ou d'augmenter les ventes par la mise en place de pratiques d'amélioration." Arnaud de Scorbiac, directeur au sein de l'activité Analytics chez Accenture, renchérit : "dans le marketing, une augmentation des ventes de 15 % est très satisfaisante."

Une accélération des capacités techniques

Le succès grandissant de l'analyse prédictive provient de plusieurs facteurs. Elle bénéficie tout d'abord de la baisse du prix de l'informatique et de l'augmentation vertigineuse des capacités de traitement et de stockage. On parle de téra-octets (mille milliards d'octets) et même de péta-octets (un milliard de milliards d'octets) de stockage. "Les PME disposent de capacités que seuls les gouvernements pouvaient s'offrir autrefois, remarque Laurent Ridoux. Les technologies d'analyse en mémoire et les traitements parallèles augmentent les capacités de traitement d'un facteur 1 000. Quant à la vitesse de traitement, elle peut augmenter d'un facteur 50 à 1 000 pour des volumes de données supérieurs à 100 téra-octets."

La rapidité des traitements ouvre des possibilités nouvelles. Ainsi, les compteurs électriques intelligents doivent pouvoir être analysés en moins de 15 minutes pour avoir un impact sur la distribution de l'électricité. De même, l'analyse du génome d'un individu, qui occupe 100 giga-octets, est passée de deux jours à quelques minutes. Ces informations devraient améliorer considérablement le traitement des cancers.

Les participants du débat

Les participants du débat

Pour tirer parti de ces évolutions, les développeurs disposent d'outils adaptés. À côté des langages librement disponibles comme R, Python et SQL, Hadoop permet de stocker ces énormes volumes de données, en particulier les données non structurées. Les utilisateurs bénéficient aussi de nouveaux outils. "Des logiciels de nouvelle génération remplacent les logiciels complexes réservés aux statisticiens : ainsi, grâce à des modèles prédéfinis, certains logiciels mettent le data mining à la portée de tous", constate Arnaud de Scorbiac.

Des économies d'un côté, des dépenses de l'autre

"Si, d'un côté, la baisse du coût du matériel et l'accès aux logiciels Open Source réduisent les factures, de l'autre, il faut prévoir des couches supplémentaires qui ont un coût significatif", prévient Marc Chemin. Les ressources humaines constituent un autre élément important des budgets. "Pour les PME, le prix des 'data scientists' est élevé", note Arnaud de Scorbiac.

Plus généralement, les projets d'analyse prédictive impliquent des budgets conséquents. Ainsi, avant de se lancer dans un projet de détection de fraude, il faut effectuer une analyse économique pour déterminer le rapport entre le coût de l'analyse et le coût des pertes à cause de la fraude. La prise en compte des médias sociaux peut, elle aussi, avoir un impact important. "Une banque affectera-t-elle quelqu'un à Twitter 24 heures sur 24 pour réagir ? Quel serait le profit par rapport au coût ?", s'interroge Frédéric Brajon.

Les nouveaux modèles économiques que suscitent ces nouvelles approches analytiques risquent de poser de vrais problèmes éthiques. Ainsi, certains assureurs commencent à adapter le tarif des contrats automobiles au comportement des conducteurs grâce aux capteurs installés dans les véhicules. "Si les nouveaux clients sont rentables, l'assurance gardera-t-elle les clients existants qui lui coûtent cher ?", se demande Marc Chemin.

Quelles compétences pour ces nouveaux domaines ?

De nouvelles compétences sont indispensables pour tirer parti de l'ensemble de ces nouvelles technologies : on parle beaucoup du "data scientist". "Mais une seule personne peut-elle avoir des compétences aussi variées ?, s'interroge Jean Charles Ravon. Le data scientist serait un mouton à 5 pattes : on peut dire qu'il est meilleur statisticien que l'informaticien et qu'il est meilleur développeur que le statisticien. En fait, il vaut mieux s'appuyer sur une équipe aux compétences complémentaires : mathématiciens, statisticiens, ingénieurs informaticiens..."

La formation de spécialistes reste toutefois une préoccupation commune des acteurs du domaine. Nombre d'entre eux s'impliquent dans des partenariats avec des écoles d'ingénieurs pour l'enseignement de la "science des données". "Il s'agit d'amener les informaticiens à travailler sur ces sujets, insiste Frédéric Brajon. Dans les entreprises, les méthodes changent pour favoriser l'agilité entre les métiers."

"Sur ces marchés, il y a trois types de profil, résume Marc Chemin : celui qui maîtrise les nouvelles technologies, l'hybride entre l'informaticien et le statisticien et enfin l'espèce rare, le data scientist : c'est surtout un informaticien formé aux statistiques, un vrai expert. Mais il n'y en aura pas beaucoup."

Des succès et des limites

"L'analytique devient une fonction pérenne, assure Laurent Ridoux. Lors des campagnes présidentielles américaines, le nombre de "data scientists" est passé d'une personne lors de la candidature de John Kerry en 2004 à 8 personnes lors de la campagne de Barak Obama en 2008 puis à 80 personnes lors de la campagne de Barak Obama en 2012." Des outils tournent en permanence, ils prennent en compte les remontées des réseaux sociaux. Ils permettent de définir chaque soir le programme de la journée suivante en déterminant qui il faut contacter, qui il est inutile de contacter et de travailler la base d'indécis.

"Mais il faut relativiser l'impact de ces nouvelles solutions, note Marc Chemin. Ainsi, autant les réseaux sociaux sont importants pour la grande distribution, autant ils n'apportent rien dans beaucoup d'autres domaines. Certains ont prétendu que les Allemands avaient gagné la coupe du monde de football avec le Big Data !!"

Cela n'enlève rien au succès de nombreux projets. Ainsi, à New York, une analyse du taux de surpopulation dans les logements, suivie d'actions adéquates, a sensiblement diminué le nombre d'incendies.

René Beretz

l'information professionnelle des progiciels de gestion intégrés

l'information professionnelle des progiciels de gestion intégrés